OpenAI 為客戶無差別提供動力強勁的藍寶堅尼,但大部分客戶的業務其實是送外賣,這構成了 OpenAI 的 「遙遙領先難題」。本文源自微信公眾號遠川科技評論所著文章《OpenAI,困於“遙遙領先“》,由元宇宙日爆整理。

(前情提要:Altman回歸後》OpenAI現況如何,微軟掌控一切?最大收入來源是什麼? )

(背景補充:OpenAI創辦人:GPT-5在路上!望微軟加碼更多資金推進通用人工智慧(AGI) )

轟動全球的大型連續劇 「Sam Altman去哪兒」 劃上了句號,但 OpenAI 的煩心事並沒有結束。

Sam Altman 能在短時間內官復原職,離不開微軟忙前忙後。今年以來,微軟一直在幫助好兄弟做大做強。不僅追加投資了 100 億美金,還大規模呼叫了微軟研究院的人力,要求放下手頭的基礎科研專案,全力將 GPT-4 等基礎大模型落地成產品,用 OpenAI 全副武裝 [1]。

但很多人不知道的是,今年 9 月,微軟研究院負責人 Peter Lee 曾接到過一個祕密專案 —— 打造 OpenAI 的替代品。

第一個 「去 OpenAI 化」 的,正是微軟的首個大模型應用 Bing Chat。

據 The Information 爆料,微軟正嘗試將原本整合在 Bing 當中的 OpenAI 大模型,逐步替換成自研版本。11 月的 Ignite 開發者大會上,微軟宣佈 Bing Chat 更名為 Copilot,如今市場定位與 ChatGPT 頗為相似 —— 很難不讓人多想。

延伸閱讀:微軟AI野心不藏了,Windows Copilot 堪稱全能助理、Bing重定義ChatGPT使用方法

不過,微軟的初衷並不是 OpenAI 的技術能力有瑕疵,也不是預見到了 OpenAI 管理層的分歧,真實原因有點讓人哭笑不得:

因為 OpenAI 的技術能力太強了。

開著藍寶堅尼送外賣

促使微軟自研大模型的契機,是 OpenAI 的一次失敗 [3]。

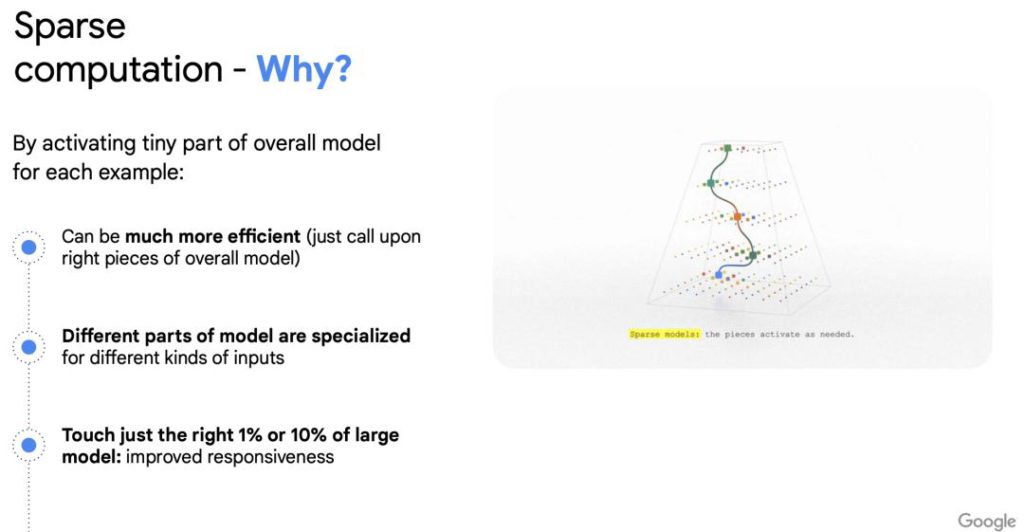

ChatGPT 轟動全球之際,OpenAI 的電腦科學家們正在忙於一個代號為 Arrakis 的專案,希望對標 GPT-4 打造一個稀疏模型(sparse model)。

這是一種特殊的超大模型:處理任務時,模型只有特定部分會被啟用。例如當用戶需要生成一段摘要時,模型會自動啟用最適合該工作的部分,不必每次都調動整個大模型。

相較於傳統的大模型,稀疏模型擁有更快的響應速度和更高的準確性。更重要的是它可以大大降低推理的成本。

翻譯成人話就是,殺雞再也不用牛刀了 —— 而這正是微軟所看重的。

延伸閱讀:GPT-4突然變笨?OpenAI被質疑「省成本」導致性能下滑、改變運算模式

輿論聊到大模型成本時,總愛談論 7、8 位數的訓練成本,以及天文數位的 GPU 開支。但對大多數科技公司而言,模型訓練和資料中心建設只是一次性的資本開支,一咬牙並非接受不了。相比之下,日常執行所需的昂貴推理成本,才是阻止科技公司進一步深入的第一道門檻。

因為在通常情況下,大模型並不像網際網路那般具備明顯的規模效應。

使用者的每一個查詢都需要進行新的推理計算。這意味著使用產品的使用者越多、越重度,科技公司的算力成本也會指數級上升。

此前,微軟基於 GPT-4 改造了大模型應用 GitHub Copilot,用於輔助程式員寫程式碼,收費 10 美元 / 月。

據《華爾街日報》的爆料,由於昂貴的推理成本,GitHub Copilot 人均每月虧 20 美金,重度使用者甚至可以給微軟帶來每個月 80 美金的損失 [5]。

大模型應用的入不敷出,才是推動微軟自研大模型的首要原因。

OpenAI 的大模型在技術上依舊遙遙領先,長期位於各大榜單的首位,但代價是昂貴的使用成本。

有 AI 研究員做過一筆測算,理論上 GPT-3.5 的 API 價格,幾乎是開源模型 Llama 2-70B 推理成本的 3-4 倍,更別提全面升級後的 GPT-4 了 [6]。

然而除了程式碼生成、解決複雜數學難題等少數場景,大部分工作其實完全可以交由引數較小的版本和開源模型。

新創公司 Summarize.tech 就是個活生生的案例。它的業務是提供總結音視訊內容的工具,擁有約 20 萬月活使用者,早期曾使用 GPT-3.5 來支援其服務。

後來,該企業試著將底層大模型更換成開源的 Mistral-7B-Instruct,發現使用者並沒有感知到差異,但每月的推理成本卻從 2000 美元降低至不到 1000 美元 [7]。

也就是說,OpenAI 為客戶無差別提供動力強勁的藍寶堅尼,但大部分客戶的業務其實是送外賣 —— 這構成了 OpenAI 的 「遙遙領先難題」。

所以不光是微軟,連 Salesforce、Wix 等 OpenAI 的早期大客戶,也已經替換成更便宜的技術方案。

降低推理成本,讓 「開奧迪比雅迪更便宜」,成為了 OpenAI 必須要解決的課題,這才有了前文提到的稀疏模型專案 Arrakis。

事實上,不光是 OpenAI,Google 也在從事相關研究,並且已經取得了進展。8 月的 Hot Chips 大會上,Google首席科學家、原Google大腦負責人傑夫・迪恩更在演講中提到,稀疏化會是未來十年最重要的趨勢之一 [8]。

正是遙遙領先帶來的高成本讓微軟琢磨起了 「自力更生」 的可能性,OpenAI 其實也注意到了這個問題:

11 月 6 日的開發者大會上,OpenAI 推出了 GPT-4 Turbo,一口氣降價 1/3,已低於 Claude 2—— 即最大競爭對手 Anthropic 開發的閉源大模型。

OpenAI 的 「藍寶堅尼」 雖然還不夠便宜,至少比其他小轎車實惠了不少。

可惜 11 天之後,一場足以載入科技史的鬧劇,正使得這一努力大打折扣。據外媒爆料,在奧特曼與 OpenAI 董事會談判回歸的那個週末,已有超過 100 個客戶聯絡了友商 Anthropic [10]。

延伸閱讀:OpenAI開發大會》最強GPT-4 Turbo新產品、可「客製化」聊天機器人上架GPT Store賺錢..

商業化的悖論

即便沒有這場內亂,OpenAI 的客戶流失危機可能依然存在。

這要從 OpenAI 的模型與產品設計思路講起:

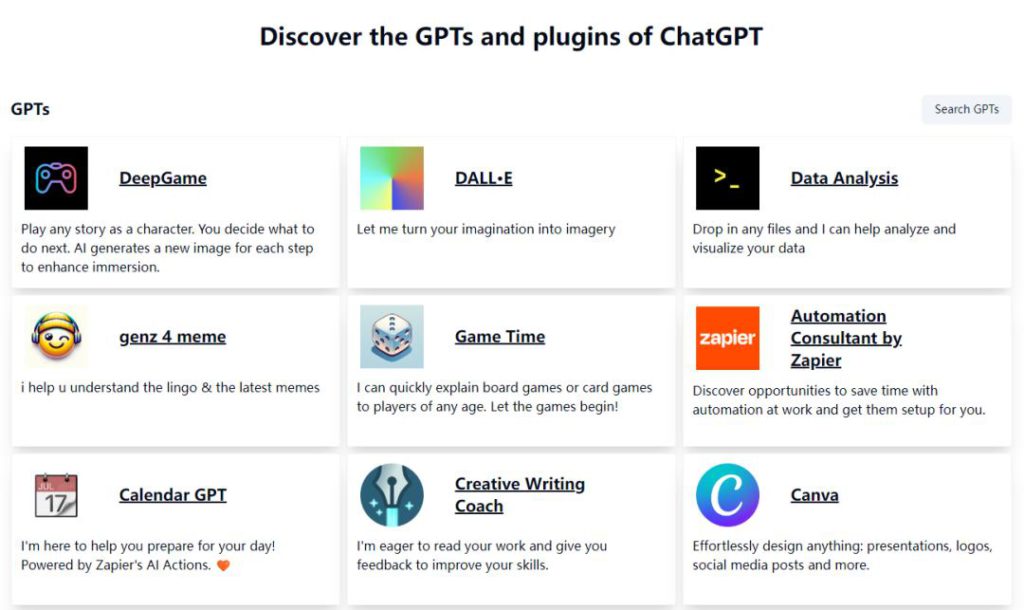

不久前,OpenAI 往開發者社群中投入了 GPTs 這顆重磅炸彈。使用者可以利用自然語言來訂製不同功能的聊天機器人。截止至奧特曼復職當天,使用者已上傳了 19000 個功能迥異的 GPTs 聊天機器人,平均日產 1000+,活躍程度堪比一個大型社群 [11]。

延伸閱讀:客製聊天機器人》OpenAI的「GPTs」是什麼?如何創建教學、開發者怎麼用GPT Store創造營收?

眾所周知,GPT 模型並不開源,而且還有 「遙遙領先難題」。但對個人開發者和小型企業來說,OpenAI 具備兩個開源模型所無法匹敵的優勢:

其一是開箱即用的低開發門檻。在海外論壇上,一些利用 OpenAI 基礎模型搞開發的小型團隊,會將自家產品形容為 「wrappers(包裝紙)」。因為 GPT 模型強悍的通用能力,他們有時只需要替模型開發一個 UI,再找到適用場景,就能拿到訂單。

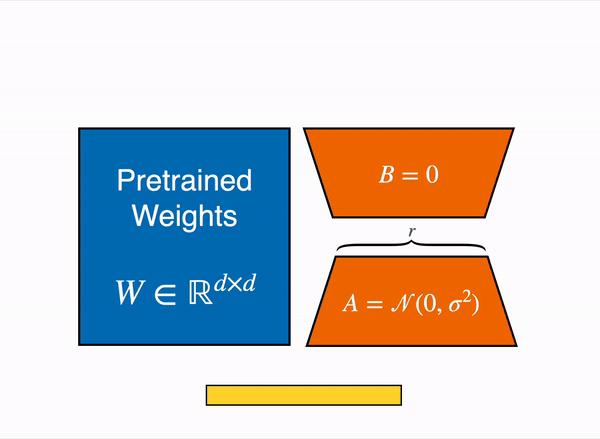

開發者如果需要進一步微調模型,OpenAI 同樣提供了一項名為的 LoRA(低秩自適應)的輕量級模型微調技術。

簡單來說,LoRA 的大致原理是先將大模型 「拆散」,再面向指定任務做適應性訓練,進而提升大模型在該任務下的能力。LoRA 主要著眼於調整模型內部結構,並不需要太多行業資料進行微調。

但在訂製開源模型時,開發者有時會使用全量微調。雖然在特定任務上表現更好,但全量微調需要更新預訓練大模型的每一個引數,對資料量要求極高。

相比之下,OpenAI 模式顯然對普通開發者更加友好。

其次,前文曾提到大模型並不具備規模效應,但這句話其實有一個前提 —— 即計算請求充足的情況下。

測試顯示,每批次傳送給伺服器的計算請求越少,對算力的利用效率會降低,進而會導致單次計算的平均成本直線上升 [6]。

OpenAI 可以一次性將所有客戶的數百萬個計算請求一起捆綁傳送,但個人開發者和中小企業卻很難做到這一點,因為並沒有那麼多活躍使用者。

簡單來說就像送快遞,同樣從上海到北京,OpenAI 客戶多,可以一次送 100 件;其他模型就湊不出這麼多了。

諮詢公司 Omdia 的分析師曾評價稱,OpenAI 從規模效應中的獲利,遠遠超過大多數在 AWS 或 Azure 上託管小型開源模型的新創企業 [14]。

所以,雖然 「ChatGPT 一更新就消滅一群小公司」 的現象客觀存在,但還是有不少開發者願意賭一把。

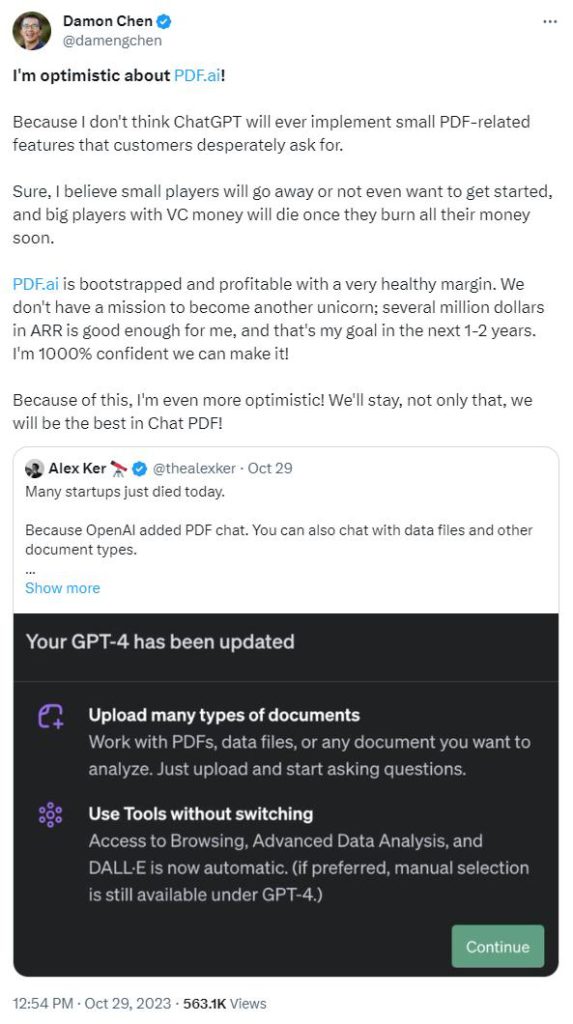

PDF.ai 的創辦人 Damon Chen 就是直接受害者,PDF.ai 的主要功能是讓模型閱讀 PDF 檔案,結果 10 月底 ChatGPT 也更新了這項能力。但 Damon Chen 卻非常淡然:「我們的使命不是成為另一家獨角獸,幾百萬美金的年收入已經足夠了」。

但對於富可敵國的大公司來說,OpenAI 的這些優勢全都成了劣勢。

比如,OpenAI 在輕量級開發上頗有優勢,但隨著企業不斷深入場景,需要進一步訂製時,很快會又一次面臨 「遙遙領先難題」:

由於 GPT-4 過於複雜且龐大,深度訂製需要耗費最低 200 萬美金和數月的開發時間。相比之下,全量微調開源模型的成本多為數十萬美元上下,兩者明顯不是一個量級。

另外,微軟、Salesforce 等大客戶自己的計算請求就夠多了,根本不需要和別人一起拼單降成本,這讓 OpenAI 在成本端優勢全無。即便是新創企業,隨著使用者不斷增加,使用 OpenAI 模型的性價比也會降低。

前文提到擁有 20 萬月活的新創公司 Summarize.tech,就成功利用開源的 Mistral-7B-Instruct 降本 50% 以上。

要知道 7B 引數的小型開源模型還可以執行在 「老古董」 級的輝達 V100 上 —— 該 GPU 釋出於 2017 年,甚至沒進美國晶片出口管制名單的法眼。

從商業角度看,能夠支撐公司營收的恰恰是財大氣粗的大公司,如何抓住那些 「野心不只數年收入百萬美金」 的客戶,已是 OpenAI 必須面對的命題。

閃點事件

讓 OpenAI 「面對商業化問題」 聽上去似乎有些奇怪,畢竟直到 2023 年初,跟賺錢相關的議題還遠不在 OpenAI 的日程表上,更別提搞什麼開發者大會了。

今年 3 月,OpenAI 總裁布羅克曼(Greg Brockman)—— 也就是上週和奧特曼一起被開除的大哥 —— 接受了一次採訪。他坦誠地說道,OpenAI 並沒有真正考慮過構建通用的工具或者垂直領域的大模型應用。雖然嘗試過,但這並不符合 OpenAI 的 DNA,他們的心也不在那裡 [17]。

持續四天半的鬧劇之後,Brockman 也再度迴歸

這裡的 DNA,其實指的是一種純粹理想主義、保護人類免受超級智慧威脅的科學家文化。畢竟 OpenAI 的立身之本很大程度上建立在 2015 年馬斯克與奧特曼的 「共同宣言」—— AI 更安全的道路將掌控在不受利潤動機汙染的研究機構手中 [18]。

理想主義大旗的號召下,OpenAI 成功招募到了以伊利亞 (Ilya Sutskever) 為首的頂尖科學家團隊 —— 儘管當時奧特曼提供給他們的薪資還不足 Google 一半。

讓 OpenAI 開始轉變的一個關鍵因素,恰恰是 ChatGPT 的釋出。

最初,OpenAI 領導並沒有將 ChatGPT 視作一款商業化的產品,而是將其稱為一次 「低調的研究預覽」,目的是收集普通人與人工智慧互動的資料,為日後 GPT-4 的開發提供助力。換句話說,ChatGPT 能火成這樣,是 OpenAI 沒有想到的。

出乎意料的爆紅改變了一切,也促使奧特曼和布羅克曼轉向了加速主義。

所謂加速主義,可以簡單理解為對 AGI 的商業化抱有無限熱情,準備大幹快上跑步進入第四次工業革命。與之對應的則是安全主義,主張用謹慎的態度來發展 AI,時刻衡量 AI 對人類的威脅。

一位匿名 OpenAI 員工在接受《大西洋月刊》採訪時說道,「ChatGPT 之後,收入和利潤都有了明確的路徑。你再也無法為『理想主義研究實驗室』的身份做辯護了。那裡有客戶正等著服務 [20]。」

ChatGPT 也催生了 「科技界最好的兄弟情誼」

這種轉變讓 OpenAI 開始踏入一個陌生的領域 —— 持續將研發成果轉換成受歡迎的產品。

對一家曾以理想主義標榜的象牙塔來說,這項工作顯然有些過於 「接地氣」 了。比如技術領袖伊利亞就是個電腦科學家而非產品經理,之前在 Google 也多負責理論研究,產品落地的職責在傑夫・迪恩領導的 Google 大腦團隊身上。

在 ChatGPT 釋出前,OpenAI 更像是幾個財富自由的科學家和工程師組成的小作坊,但時過境遷,他們變成了一個正兒八經的商業機構。

過去一年,OpenAI 新增了數百位新僱員,用於加速商業化。根據 The Information 的報導,OpenAI 的員工總數很可能已經超過 700 人。就算不考慮賺錢,也得有方法應對運營成本 —— 畢竟科學家也要還房貸啊。

短暫又劇烈的 「奧特曼去哪兒」 事件並沒有解決這個問題,反而讓它變得愈發尖銳:OpenAI 到底是個什麼組織?

在 CNBC 的一次採訪裡,馬斯克曾這樣形容由他親手創辦、後來又將他掃地出門的公司:「我們成立了一個組織來拯救亞馬遜雨林,但後來它卻做起了木材生意,砍伐了森林將其出售 [18]。」

這種矛盾使得 OpenAI 困於遙遙領先,也催生了這場驚呆所有人下巴的鬧劇。

今年早些時候,連線雜誌的記者曾跟訪了奧特曼一段時間,期間也曾反覆提及這個問題,但奧特曼每次都堅稱,「我們的使命沒有改變」。但當信奉安全主義的伊利亞滑跪,以及奧特曼回歸,顯然 OpenAI 已經做出了它的選擇。

_

參考資料

[1]How Microsoft is Trying to Lessen Its Addiction to OpenAI as AI Costs Soar,The Information

[2]Microsoft rebrands Bing Chat to Copilot, to better compete with ChatGPT,The Verge

[3]OpenAI Dropped Work on New ‘Arrakis’ AI Model in Rare Setback,The Information

[4]GPT-4 Architecture, Infrastructure, Training Dataset, Costs, Vision, MoE,SemiAnalysis

[5]Big Tech Struggles to Turn AI Hype Into Profits,The Wall Street Journal

[6]Why GPT-3.5 is (mostly) cheaper than Llama 2,Aman

[7]OpenAI’s Corporate Sales Come Under Pressure From Microsoft as AI Customers Eye Cheaper Options,The Information

[8]THE NEXT 100X FOR AI HARDWARE PERFORMANCE WILL BE HARDER,Next Platform

[9]OpenAI’s ‘Extinction Event’ For Other AI Startups,The Information

[10]OpenAI’s Customers Consider Defecting to Anthropic, Microsoft, Google,The Information

[11]GPTs Hunter

[12]What it Takes to Make Open-Source AI Cheaper Than OpenAI,The Information

[13] 圖解大模型微調系列之:大模型低秩介面卡 LoRA(原理篇),猛猿

[14]Open Source vs. Closed Models: The True Cost of Running AI,AI Business

[15]Why a New OpenAI Product Costs $2 Million,The Information

[16]「血色婚禮」 後,生成式 AI 仍在第一幕,我思鍋我在

[17]OpenAI President on Musk Criticism: ‘We Made a Mistake’,The Information

[18]What OpenAI Really Wants,Wired

[19] 深度學習革命,凱德・梅茨

[20]Inside the Chaos at OpenAI,The Atlantic

本文來自微信公眾號 「遠川科技評論」(ID:kechuangych),作者:陳彬,編輯:李墨天,視覺設計:疏睿。

📍相關報導📍

有錢也不賺》ChatGPT Plus暫停新用戶註冊,OpenAI:使用量飆升超負荷